Bygg din egen helt privata AI-assistent utan kontakt med molnet

I en tid där våra mest personliga samtal och digitala fotspår ständigt analyseras av teknikjättarnas molnbaserade algoritmer, växer behovet av digital suveränitet. Att bygga en egen AI-assistent som körs helt lokalt på din egen hårdvara är inte längre en avlägsen dröm för programmerare, utan ett fullt genomförbart projekt för den medvetna entusiasten. Genom att kombinera kraftfulla mikrodatorer med öppna språkmodeller kan du skapa en intelligent följeslagare som svarar på frågor och styr ditt hem, utan att ett enda ord någonsin lämnar ditt lokala nätverk. Detta är den ultimata guiden till att återta kontrollen över din integritet och din teknik.

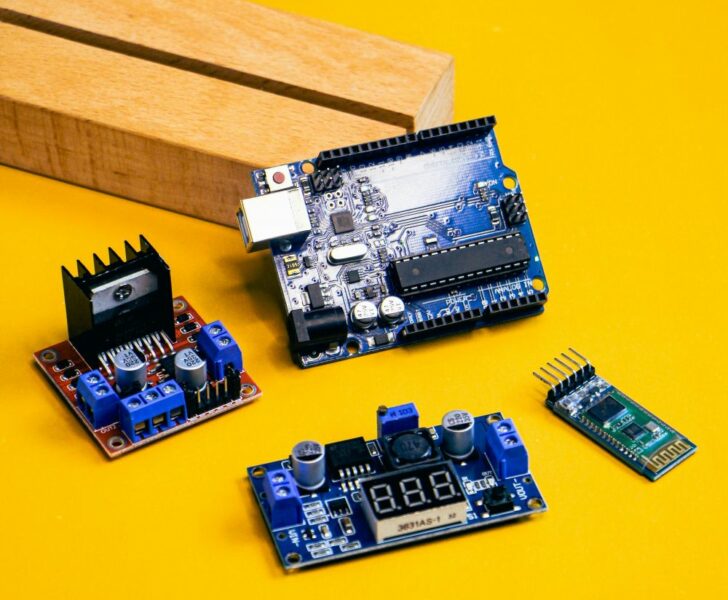

Val av rätt hårdvara för lokala språkmodeller

När man ger sig i kast med att bygga en helt privat AI-assistent är hårdvaran den absoluta grundstenen. Till skillnad från vanliga smarta högtalare som bara skickar ljuddata till en gigantisk serverpark, måste din lokala maskin bära hela den beräkningsmässiga tyngden själv. Det ställer helt nya krav på komponenter som vi i vanliga fall kanske inte prioriterar för en enkel hemmaassistent. Utmaningen ligger i att hitta en balans mellan strömförbrukning, fysisk storlek och den beräkningskraft som krävs för att köra en stor språkmodell i realtid. Om hårdvaran är för svag kommer interaktionen att kännas seg och onaturlig, vilket förtar hela upplevelsen av en intelligent följeslagare.

Grafikprocessorns centrala roll i lokal AI

Den viktigaste komponenten i ditt bygge är utan tvekan grafikprocessorn eller en dedikerad AI-accelerator. Språkmodeller bygger på massiva matrisberäkningar som vanliga processorer är relativt långsamma på att hantera. För att få snabba svar krävs ett grafikkort med mycket videominne, eftersom hela modellen behöver få plats i detta minne för att kunna köras effektivt. Många entusiaster väljer idag att bygga system baserade på kraftfulla spelkort eller specifika moduler som är optimerade för maskininlärning. Ju mer vram du har tillgång till, desto större och mer kapabel modell kan du köra utan att systemet börjar hacka eller lagra data på den betydligt långsammare hårddisken.

Minneskapacitet och lagringshastighet

Utöver grafikprocessorn spelar systemets vanliga arbetsminne en avgörande roll, särskilt om du planerar att köra assistenten på en mindre enhet som en mac med enhetligt minne eller en kraftfull enkortsdator. Hastigheten på din lagring är också kritisk under uppstarten av assistenten då flera gigabyte data ska läsas in på kort tid. En snabb nvme-disk är därför att föredra framför äldre mekaniska hårddiskar. Det handlar om att eliminera alla flaskhalsar som kan fördröja assistentens förmåga att lyssna, bearbeta och svara. Genom att investera i rätt grundutrustning skapar du en stabil plattform som kan växa i takt med att nya och mer effektiva modeller släpps på marknaden.

-

Ett dedikerat grafikkort med minst tolv gigabyte videominne för flytande interaktion.

-

En modern flerkärnig processor som kan hantera bakgrundsprocesser och röstigenkänning.

-

Minst trettiotvå gigabyte snabbt arbetsminne för att stödja operativsystem och modell.

-

En tystgående kylningslösning då AI-beräkningar genererar betydande mängder värme.

-

En stabil strömförsörjning som klarar de plötsliga belastningstoppar som uppstår vid svar.

Installation och optimering av öppna AI-modeller

När din hårdvara är monterad och klar är det dags att väcka maskinen till liv med rätt mjukvara. Skönheten med den nuvarande teknikutvecklingen är att det finns en enorm mängd öppna källkodsprojekt som gör det möjligt att köra avancerade AI-modeller på konsumenthårdvara. Att välja rätt modell handlar om att hitta en balans mellan intelligens och hastighet. En modell med för många parametrar kan bli för tung för din hårdvara, medan en för liten modell kan ge osammanhängande eller felaktiga svar. Det krävs ofta en del experimenterande med olika versioner och optimeringstekniker för att hitta just den konfiguration som passar dina specifika behov och din utrustning.

Valet mellan olika modellarkitekturer

Det finns idag flera stora familjer av öppna modeller som man kan använda som bas för sin assistent. Vissa är optimerade för att vara extremt snabba på att generera text, medan andra är bättre på att förstå komplexa instruktioner eller programmeringskod. Genom att använda tekniker som kvantisering kan man minska storleken på dessa modeller så att de tar mindre plats i minnet utan att förlora för mycket av sin förståelse. Detta är en nyckelprocess för hemmaanvändaren, då det tillåter körning av modeller som ursprungligen krävde professionell hårdvara på en vanlig hemdator. Att förstå hur man finjusterar dessa parametrar är en del av charmen och utmaningen i projektet.

Lokala servrar och användargränssnitt

För att faktiskt kunna kommunicera med din modell behöver du ett gränssnitt eller en lokal serverprogramvara som agerar brygga mellan dig och AI-hjärnan. Det finns färdiga verktyg som gör det enkelt att ladda ner och köra modeller med bara några klick, men för den som vill ha total kontroll är det ofta bättre att sätta upp en egen servermiljö. Detta gör det möjligt att skapa egna api-anrop och integrera assistenten med andra tjänster i hemmet. Genom att köra allt i en isolerad miljö, till exempel via contAIners, säkerställer du att ingen mjukvara får tillgång till internet och att din data förblir låst inom ditt eget lokala nätverk.

-

Användning av kvantiserade modeller för att spara minne och öka svarshastigheten.

-

Implementering av lokala api-gränssnitt för framtida kopplingar till andra enheter.

-

Konfigurering av brandväggar som blockerar all utgående trafik från AI-servern.

-

Val av modeller som är specifikt tränade för att följa instruktioner och kommandon.

-

Regelbundna uppdateringar av modellvikter för att dra nytta av den senaste forskningen.

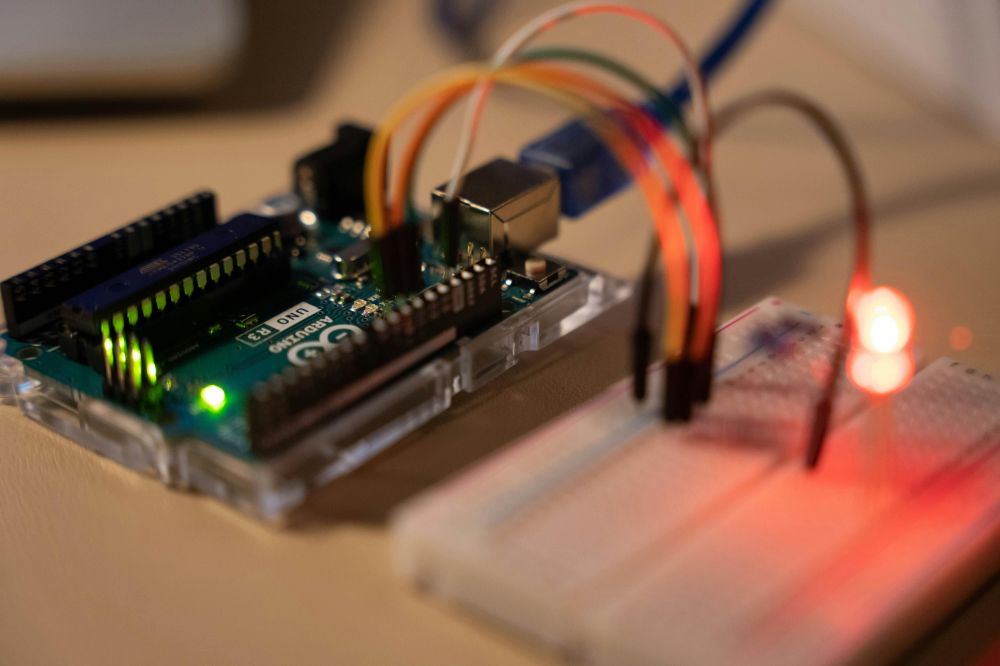

Integration och röststyrning för ett säkert smart hem

Det sista steget i projektet är att ge din AI-assistent en röst och förmågan att påverka sin fysiska omgivning. En AI-modell som bara lever i ett textfönster är visserligen användbar, men det är i interaktionen med det smarta hemmet som den verkligen blir en assistent. För att uppnå en helt privat lösning krävs det att även röstigenkänningen och talsyntesen sker lokalt på din maskin. Det innebär att du behöver installera programvara som kan omvandla dina talade ord till text utan att skicka ljudupptagningar till molnet. När detta system väl är på plats kan din assistent styra allt från belysning till mediespelare genom enkla röstkommandon.

Lokal röstigenkänning och talsyntes

Att få en dator att förstå tal i ett rum med bakgrundsljud är en teknisk utmaning som kräver bra mikrofoner och sofistikerad mjukvara. Genom att använda lokala motorer för tal-till-text kan du säkerställa att mikrofonen bara lyssnar efter ett specifikt aktiveringsord innan den börjar bearbeta instruktioner. På samma sätt krävs en motor för text-till-tal för att assistenten ska kunna svara dig med en naturlig röst. Det finns idag modeller för detta som låter förvånansvärt mänskliga och som kan köras parallellt med språkmodellen på din hårdvara. Detta skapar en sömlös cirkel av privat kommunikation där varje steg i processen ägs och kontrolleras av dig.

Bryggan till det smarta hemmet

För att din assistent ska kunna släcka lamporna eller låsa dörren behöver den kunna prata med ditt befintliga smarta hem-system. Många väljer att använda öppna plattformar för hemautomation som kan agera nav för alla dina enheter. Genom att koppla din AI-assistent till detta nav kan du ge instruktioner i naturligt språk istället för att vara låst till förbestämda kommandon. Du kan säga till din assistent att det känns lite mörkt i vardagsrummet, och AI-modellen kan då tolka detta som en önskan om att tända lamporna till en viss nivå. Det är här den verkliga magin uppstår, när avancerad logik möter vardagens enkla behov i en trygg och privat miljö.

-

Placering av högkvalitativa mikrofonarrayer för att minimera brus och eko i rummet.

-

Installation av lokala talsyntesmotorer med anpassningsbara röster och dialekter.

-

Skapande av säkra bryggor mellan språkmodellen och hemmets automatiseringsnav.

-

Definiering av specifika behörigheter så att assistenten bara når vissa funktioner.

-

Testning av svarstider för att säkerställa att röststyrningen känns responsiv och alert.