Neuromorfa chip – när AI börjar tänka mer som en hjärna

Tänk om nästa stora genombrott inom AI inte handlar om bättre algoritmer eller större datamängder — utan om hur vi bygger själva hårdvaran? Under decennier har datorer följt en och samma grundprincip: minne och processorkraft hålls isär, data pendlar konstant däremellan. Det kostar enorma mängder energi. Nu utmanas den modellen på allvar. Neuromorfa chip designas för att efterlikna hjärnans arkitektur, där minne och beräkning sker i samma nätverk av artificiella neuroner och synapser som kommunicerar via elektriska ”spikes”. Resultatet är ett helt nytt sätt att tänka på intelligens — bokstavligen talat.

Hjärnan som ingenjörernas största förebild

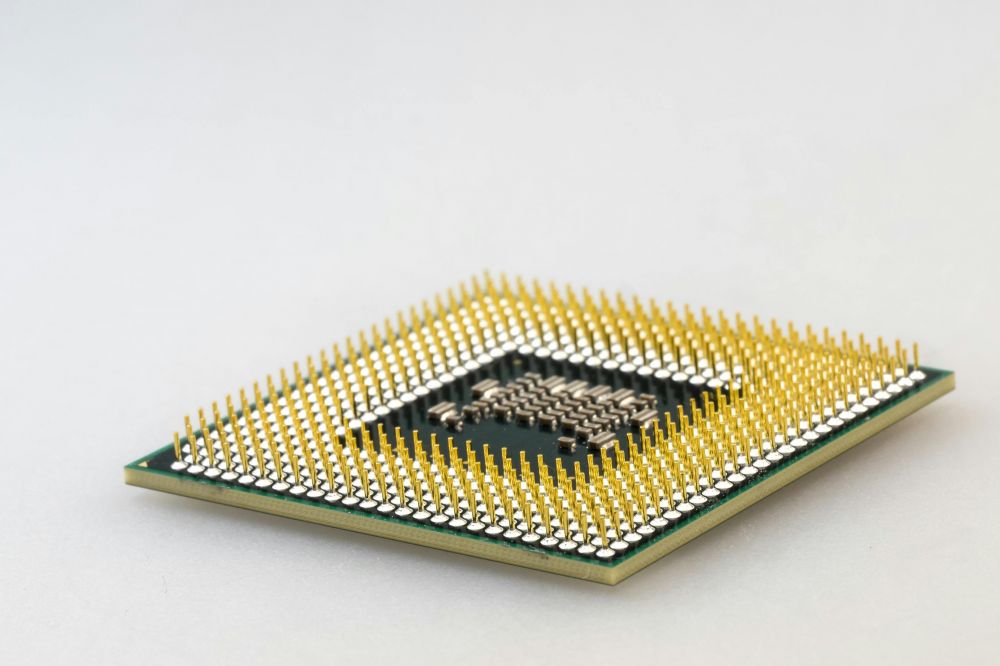

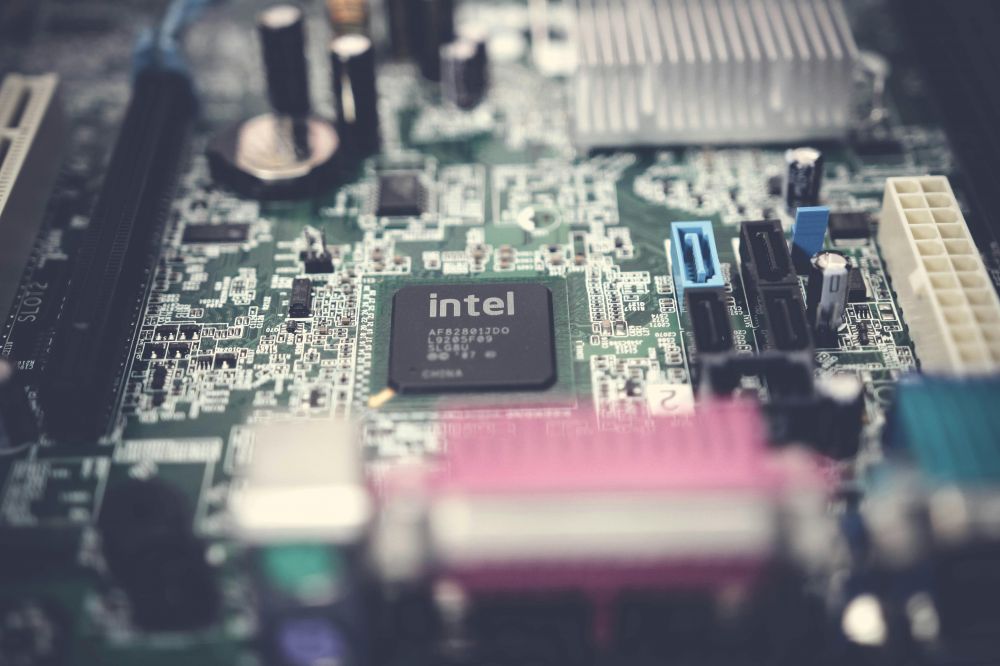

Under decennier har datorarkitekturen följt ett och samma mönster. I mitten av 1900-talet formaliserade matematikern John von Neumann en modell där processorn och minnet hålls åtskilda, kopplade samman av en dataväg som ständigt skickar information fram och tillbaka. Data exekveras och lagras på två helt separata platser i konventionella datorer, nämligen processorn och arbetsminnet. Det innebär att processorn måste hämta data från minnet, bearbeta det och sedan skicka tillbaka det, vilket leder till extra energiåtgång under dataöverföringens gång. Det låter kanske som ett tekniskt detaljproblem, men i en tid då AI-modeller växer i storlek för varje år är det en av de mest akuta hindren för hållbar och snabb datorutveckling.

Mead och det biologiska uppvaknandet

Det var Carver Mead, professor vid Caltech, som på allvar satte ord på alternativet. Mead pekade i ett banbrytande paper från 1990 på den extraordinära energisnålheten i biologisk beräkning, och myntade begreppet ”neuromorphic”. Inspirationen kom direkt från hur den mänskliga hjärnan fungerar. Neuroner kommunicerar inte som en vanlig processor med kontinuerliga strömmar av data, utan med kortvariga elektriska pulser, så kallade spikes. Hjärnan kringgår von Neumann-problemet genom att behandla lagring och beräkning som samma sak, lokalt och simultant i varje nod av nätverket.

Det som gör denna princip så lockande är inte bara energieffektiviteten utan också parallellismen. I konventionella datorer utförs instruktioner i sekvens, ett steg i taget. Hjärnan är i stället karaktäriserad av en parallell arkitektur, som använder ett stort antal neuroner och synapser, och neuromorfa chip modellerar typiskt miljontals neuroner och synapser som är sammankopplade i ett enormt nätverk av kärnor.

Spikes, synapser och artificiellt lärande

Det centrala konceptet bakom neuromorft datorteknik är spiking neural networks, förkortat SNN. Till skillnad från de artificiella neurala nätverk som driver dagens AI-modeller aktiveras neuroner i ett SNN enbart när en signal når över ett visst tröskelvärde. Informationen kodas inte som diskreta skalära värden som klocksynkront skickas genom nätverket. I stället opererar systemet på kontinuerliga ingångsvärden och kodar information genom tidpunkten, storleken och formen på de spikes som utlöses mellan neuronerna.

Det innebär att en neuromorft chip i praktiken är tyst det mesta av tiden. Den aktiveras precis när den behöver det, och slumrar annars i ett extremt lågenergiläge. I konventionell datorarkitektur driver en global klocka processorn att kontinuerligt utföra instruktioner, och energi förbrukas oavsett om informationen är användbar. I neuromorfa system sker beräkning enbart som svar på spikes från andra artificiella neuroner, vilket innebär att endast de delar av nätverket som behandlar ny information drar märkbar energi, medan resten befinner sig i ett lågenergiläge.

Förmågan att lära sig i realtid är en annan egenskap som skiljer neuromorfa system från traditionell maskininlärning. Mekanismer som spike-timing-dependent plasticity, STDP, justerar styrkan i kopplingarna mellan neuroner baserat på tidpunkten för deras spikes, vilket gör det möjligt för nätverket att lära sig av tidsmönster i datan på ett sätt som liknar hur människor lär sig av erfarenheter över tid. Det är ett fundamentalt annorlunda sätt att ta till sig information, och ett som potentiellt kräver betydligt mindre beräkningskraft.

Från laboratorium till verklighet – så används neuromorfa chip idag

Det är lätt att avfärda neuromorft datorteknik som ett akademiskt experiment, en lösning som alltid verkar vara ”tio år bort” från genombrott. Men bilden har förändrats markant under de senaste åren. Chip som faktiskt fungerar i verkliga miljöer, inte bara i kontrollerade laboratorier, börjar bli verklighet. Och de aktörer som driver på är allt annat än okända.

Intels Loihi och IBMs TrueNorth

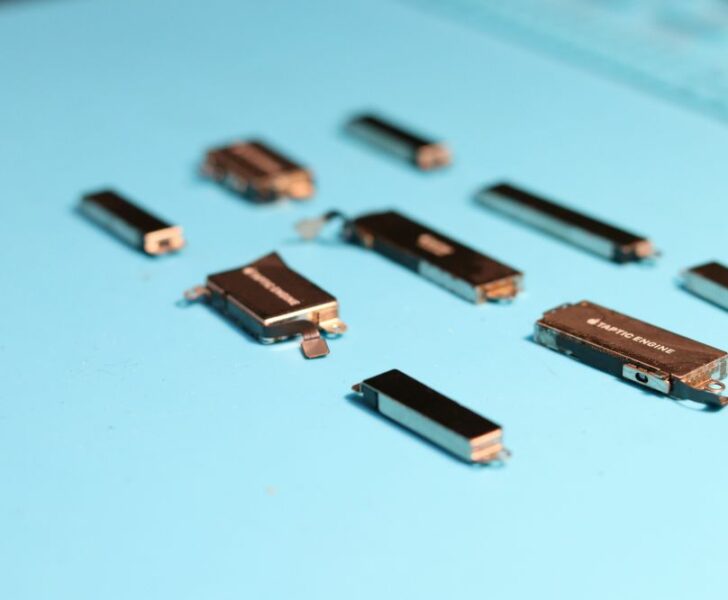

Neuromorfa processorer på marknaden inkluderar Loihi från Intel, NeuronFlow från GrAI Matter Labs samt TrueNorth och nästa generations NorthPole från IBM. De flesta neuromorfa enheter är tillverkade av kisel och använder CMOS-teknologi, men forskare undersöker även nya typer av material, som ferroelektriska och fasändringsmaterial.

Intels Loihi-projekt är ett av de mest omfattande och välfinansierade initiativen. Loihi 2, Intels andra generationens neuromorfa processor, överträffar sin föregångare med upp till tio gånger snabbare bearbetningskapacitet. Till detta ska läggas systemet Hala Point, som består av 1 152 Loihi 2-chip sammanfogade och ger miljarder artificiella synapser. Intel hävdar att prototyperna kör 50 gånger snabbare med 100 gånger lägre energiförbrukning jämfört med GPU:er.

Konkreta tillämpningar i industri och medicin

Från det teoretiska till det praktiska: neuromorfa chip har börjat hitta verkliga hem i industrin. Forskare implementerade ett neuromorft algoritm på Loihi för att detektera körfält med hjälp av händelsebaserade kameror. Systemet levererade realtidsigenkänning på under åtta millisekunder och förbrukade enbart ungefär en watt effekt.

Inom medicin öppnar sig ännu mer lovande möjligheter. I maj 2025 rapporterade forskare vid ETH Zürich om en realtidsmonitor för epileptiska anfall, byggd på neuromorft hårdvara, som potentiellt kan hjälpa personer med epilepsi. Samma typ av låglatens och låg energiåtgång som gör neuromorfa chip lämpliga för epilepsiövervakning gör dem attraktiva inom autonoma fordon, där förutsägelser måste göras på under en millisekund, och inom bärbara hälsoenheter.

En av de mest fascinerande demonstrationerna är vad forskargrupper åstadkommit inom robotik. Vid TU Delft byggde forskare en fullständigt neuromorft styrd flygande drönare. Dess händelsebaserade kamerainput och styrnätverk kördes på ett Intel Loihi-chip ombord, med bearbetningshastigheter upp till 64 gånger högre än en GPU och ungefär tre gånger lägre energiförbrukning.

Följande områden visar den bredaste tillämpningspotentialen för neuromorfa chip idag:

- Autonom robotik och drönare som kräver realtidsnavigering utan molnanslutning

- Bärbara medicinska enheter för kontinuerlig fysiologisk övervakning

- Telekommunikationsoptimering, där Ericsson Research samarbetar med Intels Loihi 2

- Industriell automation med prediktivt underhåll av maskiner

- IoT-sensorer som behöver fungera i år på ett enda batteri

Kina och det globala kapprustningsloppet

Det är inte bara västerländska techbolag som satsar. Kinas Darwin Monkey-projekt byggde en rack-skalad neuromorft dator med över två miljarder neuroner och 100 miljarder synapser, men förbrukar ändå bara ungefär 2 000 watt. Kinas statsstödda initiativ kompletterar detta med rapporterade löften om upp till 150 miljarder dollar till inhemsk AI- och chip-forskning. Det neuromorfa fältet är med andra ord inte bara en teknisk frontier, utan en geopolitisk sådan.

Framtidens AI går på en bråkdel av strömmen

Det finns en siffra som sätter hela diskussionen om neuromorfa chip i perspektiv. År 2022 förbrukade datacenter, AI och relaterade teknologier ungefär 460 TWh globalt. Denna siffra beräknas mer än fördubblas till nästan 1 000 TWh år 2026, en energimängd jämförbar med Japans totala energiförbrukning. Det handlar inte om en abstrakt miljöfråga längre. Det handlar om infrastruktur, nationell konkurrenskraft och om hur länge den nuvarande AI-modellen ekonomiskt sett är hållbar.

Hjärnans fysik som lösning

Den mänskliga hjärnan är det mest energieffektiva beräkningssystem vi känner till. Hjärnan fungerar på ungefär 20 watt och anses kapabel att fatta långt mer komplexa beslut med enbart en tiotusendel av den energi som dagens digitala AI-bearbetning förbrukar. Det är en skillnad så stor att den närmast verkar overklig, och det är precis denna klyfta som neuromorft datorteknik försöker överbrygga.

Neuromorfa chip har potentialen att överträffa traditionella datorer i energi- och utrymmeseffektivitet. I takt med att AI:s elförbrukning beräknas fördubblas till 2026 framstår neuromorft datorteknik som en lovande lösning. Det är inte ett argument som längre enbart levereras av forskare med akademiska intressen. Det är ett argument som börjar höras i styrelsesalar och hos lagstiftare.

Från GPU-farmar till spiknätverk

En av de mest konkreta demonstrationerna av vad som är möjligt är forskningen kring stora språkmodeller på neuromorft hårdvara. I april 2025 presenterade Jason Eshraghian och hans medarbetare vid en internationell konferens en stor språkmodell anpassad för att köra på ett Loihi 2-chip från Intel, den första LLM som vad de känner till körts på neuromorft hårdvara. Den var lika noggrann som en jämförbar GPU-baserad modell men använde hälften så mycket energi.

Forskargrupper undersöker nu även helt nya material och tillverkningsmetoder för att pressa ner energiåtgången ytterligare. Stödd av delstaten Niedersachsen och Volkswagen-stiftelsen med 15 miljoner euro inleddes i april 2026 projektet BRIGHT, som syftar till att skapa en neuromorft dator baserad på mikroskopiskt små LED-komponenter. Projektet löper till 2031 och strävar efter att kraftigt reducera AI-systemens miljöavtryck.

Hindren som återstår

Det vore missvisande att måla upp en bild utan skuggor. Trots de imponerande framstegen finns det reella utmaningar kvar. Neuromorft dataprogramvara har inte hängt med i hårdvarans utveckling. Merparten av neuromorft forskning bedrivs fortfarande med standardmjukvara för djupinlärning, utvecklad för von Neumann-hårdvara, vilket begränsar resultaten till konventionella angreppssätt.

Det saknas också tillräckligt med utbildad arbetskraft. Fältet kräver kompetens som spänner över neurovetenskap, halvledarfysik och maskininlärning simultaneously, en kombination som idag är sällsynt. Men allt fler universitet bygger ut program inom neuromorft datorteknik, och standardiseringsinitiativ börjar ta form. Initiativ inom det neuromorfa samfundet för att standardisera riktmärken syftar till att mäta framsteg på både energi och prestanda, och vägen framåt kräver samdesign av hårdvara och algoritmer.

Det är just den samdesignen som pekar mot framtiden. Neuromorfa chip är inte bara en energibesparande teknologi. De representerar ett fundamentalt annorlunda sätt att tänka på vad en dator är, och vad intelligent beräkning egentligen kan vara.